什么是大型语言模型(LLM)?完整初学者指南

作者:Kobkrit Viriyayudhakorn博士,iApp Technology CEO兼创始人

您可能听说过ChatGPT、Claude或Google的Gemini。这些都是由一种叫做大型语言模型或LLM的技术驱动的。但LLM究竟是什么?它是如何工作的?为什么您应该关注它?

在这本初学者友好的指南中,我们将用简单的术语解释您需要了解的关于LLM的一切——不需要博士学位!

什么是大型语言模型(LLM)?

**大型语言模型(LLM)**是一种能够理解、生成和处理人类语言的人工智能。把它想象成一个非常复杂的自动完成系统——但它不仅仅是预测下一个词,它可以写整篇文章、回答复杂的问题、翻译语言,甚至编写代码。

简单类比

想象一下,您有一个朋友,他读过互联网上的每一本书、每一篇文章和每一个网站。当您问他问题时,他可以利用所有这些知识给您一个深思熟虑的答案。这基本上就是LLM所做的——只是它是一个从数十亿文本文档中"学习"的计算机程序。

您需要知道的5个关键术语

在深入之前,让我们澄清一些经常让初学者困惑的术语:

1. 令牌(Token)

令牌是LLM用来处理文本的基本单位。它不完全是一个词——更像是一块文本。

| 文本 | 令牌数 |

|---|---|

| "Hello" | 1个令牌 |

| "Hello world" | 2个令牌 |

| "สวัสดีครับ"(泰语:你好) | 3-4个令牌 |

| "Artificial Intelligence" | 2个令牌 |

为什么重要: LLM定价通常基于令牌数。更多令牌=更高成本。泰语通常比英语使用更多令牌来表达相同的意思。

2. 参数(Parameters)

参数是存储在LLM内部的"知识"。把它们想象成AI的脑细胞。

- GPT-3: 1750亿参数

- GPT-4: ~1.7万亿参数

- Chinda泰语LLM: 40亿参数

- DeepSeek-V3: 6850亿参数

为什么重要: 更多参数通常意味着更好的理解和更细微的响应,但也需要更多的计算能力。

3. 提示(Prompt)

提示是您给LLM的输入——您的问题或指令。

好的提示:"用3句话向10岁的孩子解释光合作用。"

不好的提示:"光合作用?"

为什么重要: 提示的质量直接影响响应的质量。这项技能被称为"提示工程"。

4. 上下文窗口(Context Window)

上下文窗口是LLM在单次对话中能够"记住"的文本量。

| 模型 | 上下文窗口 |

|---|---|

| GPT-3.5 | 4,096个令牌 |

| GPT-4 | 128,000个令牌 |

| Chinda泰语LLM | 40,960个令牌 |

| DeepSeek-V3 | 128,000个令牌 |

为什么重要: 更大的上下文窗口意味着AI可以处理更长的文档并记住更多您的对话。

5. 幻觉(Hallucination)

幻觉是指LLM生成听起来自信但实际上是虚假或编造的信息。

示例:

- 问题:"谁写了泰国小说《暹罗失落的王国》?"

- 幻觉答案:"它是由Kukrit Pramoj于1965年写的。"

- 真相: 这本小说根本不存在!

为什么重要: 始终验证LLM输出中的重要事实,特别是对于关键决策。

为什么LLM很重要?

LLM正在改变我们工作、学习和交流的方式。以下是它们重要的原因:

1. 使AI民主化

以前,使用AI需要广泛的技术知识。现在,任何人都可以通过自然语言与AI交互。

2. 提高生产力

以前需要几小时的任务现在可以在几分钟内完成:

- 撰写电子邮件和报告

- 总结长文档

- 语言翻译

- 生成代码

3. 打破语言障碍

LLM可以翻译和理解多种语言,使信息在全球范围内更容易获取——包括泰语!

4. 推动创新

从客户服务聊天机器人到医疗诊断辅助,LLM正在各行各业实现新的应用。

LLM解决什么问题?

内容创作

- 撰写营销文案、博客文章和社交媒体内容

- 生成产品描述

- 创建教育材料

客户服务

- 24/7自动化支持聊天机器人

- 即时回答常见问题

- 多语言客户支持

数据分析

- 总结大型文档

- 从文本数据中提取洞察

- 客户反馈情感分析

法律和合规

- 审查合同

- 回答法律问题

- 用通俗语言解释法规

代码开发

- 编写和调试代码

- 解释编程概念

- 在不同编程语言之间转换代码

翻译

- 实时语言翻译

- 为不同市场本地化内容

- 跨语言保持上下文和语气

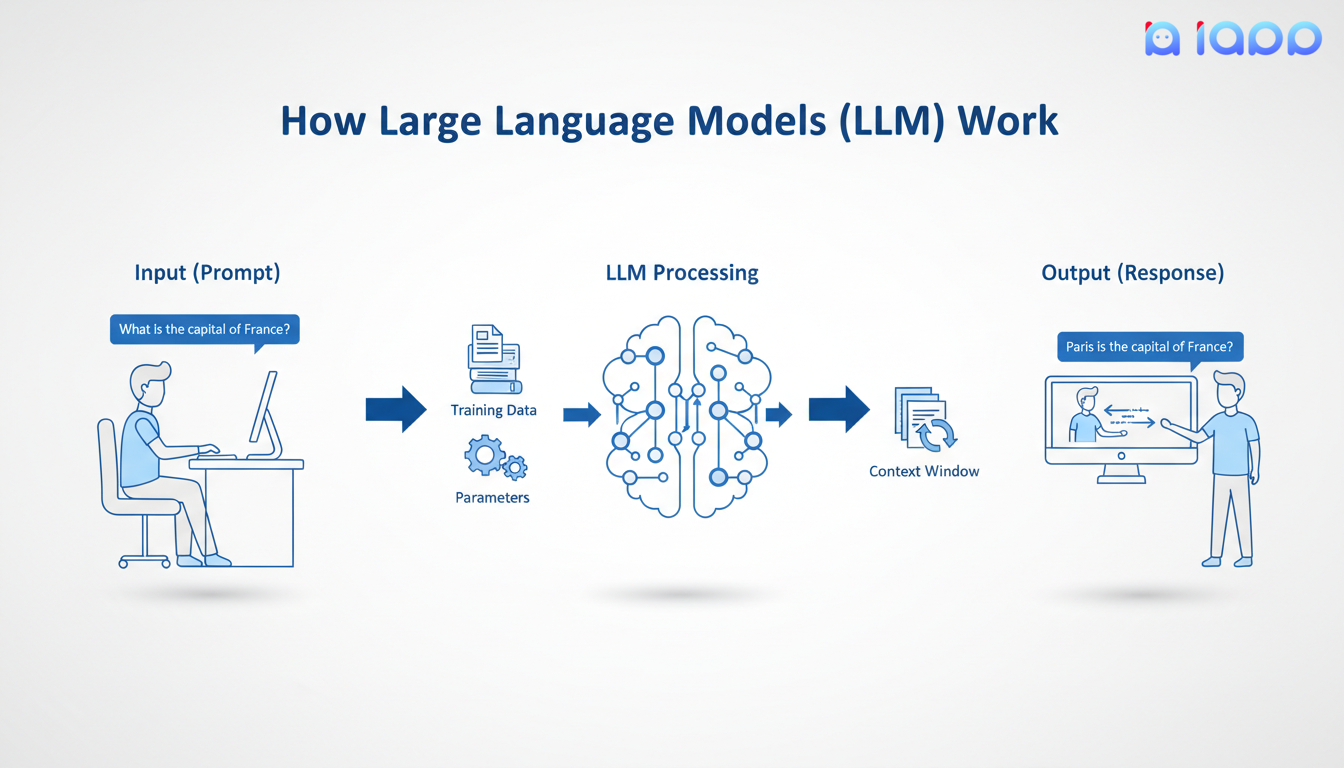

LLM如何工作?

让我们用简单的术语解释LLM背后的魔力:

第1步:训练(学习阶段)

LLM阅读来自书籍、网站和文章的数十亿文本文档。在这个过程中,它学习:

- 语法和语言结构

- 事实和知识

- 人类交流的模式

- 概念之间的上下文和关系

第2步:理解模式

LLM不是记忆文本,而是学习统计模式。例如:

- 在"泰国的首都是..."之后,"曼谷"这个词可能性很高

- 在"早上好"之后,预期会有问候回应

- 技术问题预期得到技术答案

第3步:生成响应

当您给出提示时,LLM会:

- 将您的文本转换为令牌

- 通过数十亿参数处理令牌

- 预测最可能的下一个令牌

- 生成连贯的响应

神经网络架构

现代LLM使用一种叫做Transformers的技术(由Google于2017年引入)。关键组件包括:

- 注意力机制:帮助模型关注输入的相关部分

- 层:多个处理层来改进理解

- 训练数据:数据的质量和数量影响模型性能

如何使用LLM

方法1:聊天界面

最简单的方法是通过ChatGPT、Claude或iApp的AI服务等聊天界面。

方法2:API集成

对于开发者,LLM可通过API使用。以下是使用iApp的Chinda泰语LLM的示例:

import requests

response = requests.post(

"https://api.iapp.co.th/v3/llm/chinda-thaillm-4b/chat/completions",

headers={"apikey": "YOUR_API_KEY"},

json={

"model": "chinda-qwen3-4b",

"messages": [

{"role": "user", "content": "อธิบายเกี่ยวกับ AI ให้หน่อย"}

],

"max_tokens": 4096

}

)

print(response.json()["choices"][0]["message"]["content"])

方法3:本地部署

一些开源LLM如Chinda可以在您自己的计算机上运行,以保护隐私和节省成本。

泰国场景中的LLM示例

示例1:泰国法律AI(Thanoy)

需要法律建议吗?iApp的Thanoy是专门研究泰国法律的LLM:

用户: โดนโจรตีหัว ผิดมาตราอะไรครับ(被强盗打了头,违反了什么条款?)

Thanoy: การถูกทำร้ายร่างกายเช่นนี้ อาจเข้าข่ายความผิดตามประมวลกฎหมายอาญา...

(这种人身伤害可能属于刑法规定的犯罪...)

Thanoy已经在超过10,000篇泰国法律文章上进行了训练,可以在几秒钟内回答法律问题。

示例2:泰语理解(Chinda)

Chinda是泰国第一个开源泰语LLM,专门针对泰语理解进行了优化:

用户: สรุปข่าวนี้ให้หน่อย: [长新闻文本](请总结这条新闻)

Chinda: ข่าวนี้พูดถึง... [简洁总结](这条新闻说的是...)

示例3:高级推理(DeepSeek-V3)

对于需要深度推理的复杂任务:

用户: 请一步一步帮我解决这道数学题...

DeepSeek: 让我仔细思考一下...

[显示详细的推理过程]

泰国真实案例:灾难救援

在2024年泰国南部洪水期间,Chinda LLM被用于自动解析社交媒体上数千条紧急求助请求:

输入(杂乱的社交媒体帖子):

ขอความช่วยเหลือ คุณแม่ติดอยู่ในบ้าน น้ำเข้าบ้านประมาณเอว

มีโรคประจำตัวเบาหวาน โทร. 081-234-5678

(求助,母亲被困在家中,水已经到腰部

有糖尿病,电话:081-234-5678)

输出(结构化数据):

{

"location": "洪水区的房屋",

"situation": "腰部水位",

"medical_condition": "糖尿病",

"contact": "081-234-5678",

"urgency": "高"

}

这种自动化帮助救援协调员更快地确定优先级和响应!

iApp Technology的LLM服务

在iApp Technology,我们提供多种专为泰国企业定制的LLM解决方案:

Chinda泰语LLM 4B

- 免费至2025年12月31日

- 针对泰语优化

- 开源,可本地运行

- 试用Chinda演示

Thanoy法律AI

- 专门研究泰国法律

- 访问超过10,000篇法律文章

- 15秒快速响应

- 试用Thanoy演示

DeepSeek-V3.2

- 6850亿参数

- 高级推理能力

- 具有竞争力的定价(约10泰铢/1M输入令牌)

- 试用DeepSeek演示

开始使用iApp LLM APIs

第1步:创建免费账户

访问 iapp.co.th/register �创建您的账户。

第2步:获取API密钥

前往 API密钥管理 生成您的密钥。

第3步:进行第一次API调用

curl -X POST "https://api.iapp.co.th/v3/llm/chinda-thaillm-4b/chat/completions" \

-H "apikey: YOUR_API_KEY" \

-H "Content-Type: application/json" \

-d '{

"model": "chinda-qwen3-4b",

"messages": [{"role": "user", "content": "สวัสดีครับ"}]

}'

第4步:探索更多

总结

大型语言模型正在改变我们与技术互动的方式。以下是我们涵盖的内容:

- LLMs 是理解和生成人类语言的AI系统

- 关键术语:令牌、参数、提示、上下文窗口、幻觉

- 应用:内容创作、客户服务、数据分析、法律AI、编码

- 泰国解决方案:Chinda(泰语LLM)、Thanoy(法律AI)、DeepSeek(高级推理)

AI革命已经到来,泰国企业可以通过iApp Technology的API利用这些强大的工具。

准备好尝试LLM了吗?

今天就开始探索大型语言模型的力量:

- 创建免费账户 - 几分钟内即可开始

- 试用Chinda泰语LLM - 免费泰语AI

- 探索所有AI APIs - OCR、语音、NLP等

- 联系我们 - 企业解决方案

有问题�吗?加入我们的Discord社区或发送电子邮件至support@iapp.co.th。

iApp Technology Co., Ltd. 泰国领先的AI公司